Si existen las trampas con IA, ¿por qué no un anticheat con IA?

Dentro de Waldo, el anticheat de IA desarrollado por Basically Homeless

En resumen: El YouTuber Basically Homeless lanzó un anticheat visual experimental llamado Waldo que analiza secuencias de juego con modelos de visión profunda (Vision Transformers) para puntuar clips con alta probabilidad de contener trampas. Funciona localmente, opera en clips cortos de eliminaciones, proporciona mapas de calor a nivel de fotograma y puntuaciones de confianza, y está pensado como una herramienta optativa de investigación, más que como un anticheat comercial llave en mano.

Introducción: una pregunta sencilla, una idea importante

Si se utiliza la IA para crear trampas sofisticadas, ¿por qué no se usa la IA para detenerlas? Waldo responde a esta pregunta desplazando la superficie de detección de la memoria del cliente y los ganchos de entrada al flujo de vídeo renderizado. Al tratar la salida del juego como la fuente de datos y aplicar modelos modernos de visión por vídeo, Waldo intenta identificar señales de comportamiento consistentes con una puntería automatizada o asistencia, ofreciendo explicabilidad a través de mapas de atención a nivel de fotograma.

Este enfoque replantea la detección como una tarea visual y auditable, que puede complementar los sistemas anticheat existentes en lugar de reemplazarlos.

¿Quién construyó Waldo?

Basically Homeless (nombres en línea: BasicallyHomeless en YouTube, Mr-Homeless en GitHub) es un creador e investigador independiente conocido por sus provocadoras demostraciones y herramientas relacionadas con videojuegos, entrada y accesibilidad. Waldo se publica como un repositorio experimental y se acompaña de vídeos de demostración. El proyecto está destinado a la investigación, no a su implementación inmediata en producción.

Cómo funciona Waldo: resumen técnico

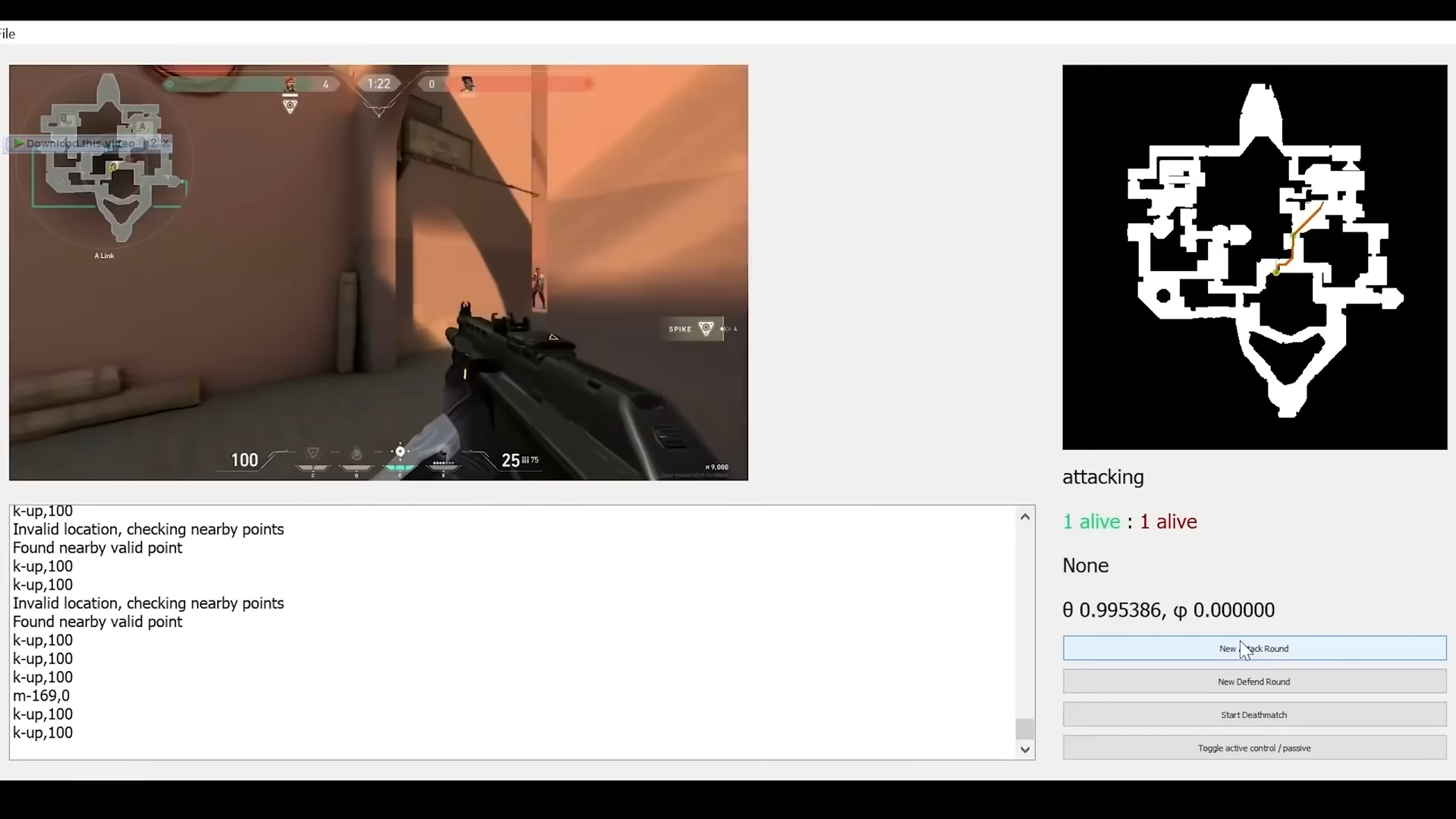

El proceso de Waldo es conceptualmente sencillo y se centra en la explicabilidad:

- Fuente de datos: vídeo de juego renderizado o clips cortos de eliminaciones extraídos automáticamente.

- Preprocesamiento: aislar eventos de interés (eliminaciones); recortar alrededor de la región de la mira/punto de mira; estandarizar las pilas de fotogramas.

- Arquitectura del modelo: modelos de vídeo/visión basados en transformadores (ej., VideoMAE / variantes de Vision Transformer) ajustados con ejemplos etiquetados de clips sospechosos versus legítimos.

- Salida de inferencia: puntuación de confianza por clip (rango definido por la implementación), mapas de calor de atención/ROI por fotograma, y exportaciones JSON opcionales para clasificación o agregación posteriores.

- Modelo de implementación: ejecución local y optativa, capaz de funcionar en las máquinas de los usuarios para investigación; los modelos y el código son abiertos para su auditoría y reentrenamiento. La decisión de analizar los fotogramas renderizados proporciona dos beneficios prácticos: es menos invasivo que los ganchos a nivel de kernel y produce visualizaciones interpretables por humanos que los investigadores pueden inspeccionar.

Hallazgos de la demostración y comportamiento práctico

Las demostraciones públicas muestran a Waldo clasificando clips subidos y devolviendo un informe breve: una métrica de confianza más una superposición de atención que resalta qué fotogramas u objetos influyeron en la decisión. En ejemplos controlados, el modelo diferencia ejemplos claros de puntería automatizada del juego casual. Sin embargo, las demostraciones también dejan claras las incertidumbres:

- Jugadores humanos de alto nivel ocasionalmente obtienen puntuaciones de alta confianza.

- Los artefactos de compresión, las superposiciones del HUD o la configuración de la cámara/vista cambian las respuestas del modelo.

- Los umbrales y etiquetas del modelo dependen en gran medida del conjunto de datos de entrenamiento. Debido a que el repositorio es abierto, los investigadores pueden reproducir experimentos y explorar el comportamiento del modelo en diferentes distribuciones de datos.

Fortalezas

- No invasivo: opera sobre la salida visual, evitando la inspección de la memoria del cliente o los controladores de kernel.

- Explicabilidad: las visualizaciones a nivel de fotograma facilitan la justificación de las marcas y permiten la clasificación humana.

- Auditabilidad y valor investigativo: un repositorio abierto permite la validación independiente y la mejora del modelo.

- Modular: puede integrarse como una señal auxiliar en arquitecturas anticheat multicapa (investigación, agregación de pruebas).

Limitaciones y riesgos

- Falsos positivos: el juego humano excepcional, las superposiciones de stream o los ángulos de cámara específicos pueden clasificarse erróneamente. Las marcas no deben usarse solas para acciones punitivas.

- Sesgo de entrenamiento: conjuntos de datos limitados o sesgados producirán modelos frágiles que no se generalizan bien en diferentes mapas, armas o estilos de juego.

- Contramedidas adversarias: la detección visual puede ser evadida modificando los HUD, suavizando las entradas o añadiendo perturbaciones adversarias a los fotogramas renderizados.

- Escala operativa: los modelos de vídeo basados en transformadores son computacionalmente pesados; la inferencia en tiempo real a escala masiva es costosa.

- Consideraciones de privacidad: los clips de juego pueden contener información de identificación personal (voz, rostros, chat), por lo que se requiere consentimiento y políticas adecuadas de manejo de datos.

Consideraciones éticas, legales y de política

Cualquier implementación o uso investigativo de un anticheat visual requiere políticas claras:

- Consentimiento y transparencia: los jugadores deben ser informados y dar su consentimiento cuando sea posible si se va a analizar su juego.

- Supervisión humana: las puntuaciones automatizadas deben desencadenar flujos de revisión; las prohibiciones o sanciones requieren verificación por parte de un investigador.

- Retención y minimización de datos: conservar solo las pruebas necesarias para la clasificación e implementar seudonimización o ventanas de retención limitadas.

- Divulgación de investigación vs. abuso: publicar herramientas de detección ayuda a los defensores, pero también permite a los atacantes probar y adaptarse; hay que equilibrar la apertura con la divulgación responsable.

Dónde encaja la IA visual en un sistema anticheat

La IA visual se implementa mejor como una señal complementaria en una estrategia de defensa en capas:

- Capa de prevención: cliente seguro, ejecución confiable y comprobaciones de coherencia del lado del servidor.

- Capa de detección: telemetría y análisis de comportamiento combinados con IA visual para obtener pruebas explicables.

- Capa de investigación: clasificación humana, correlación cruzada de hallazgos visuales con registros del servidor y entradas.

- Capa de remediación: respuestas graduadas basadas en pruebas de múltiples fuentes y revisión humana. Cuando se utilizan de manera responsable, los modelos visuales aumentan la evidencia disponible para los investigadores y pueden ayudar a priorizar la revisión manual en operaciones a gran escala.

Conclusión

Waldo destaca una dirección práctica y explicable para la detección de trampas asistida por IA, al tratar el juego renderizado como una fuente de datos. Demuestra el potencial de las señales de detección no invasivas y auditables, especialmente valiosas para investigadores de incidentes. Sin embargo, las limitaciones del modelo, las preocupaciones sobre la privacidad y la dinámica adversaria significan que la IA visual debe aumentar, no reemplazar, las arquitecturas anticheat integrales.

Enlaces: Sitio Oficial de Waldo Salvando los Juegos FPS - Vídeo de IA Anticheat en YT